Per anni i deepfake sono stati considerati una curiosità tecnologica, confinata tra esperimenti accademici e contenuti virali a basso impatto. Oggi non è più così. I cosiddetti media sintetici sono entrati in una fase industriale, trasformandosi in uno strumento sistemico capace di incidere contemporaneamente su informazione, finanza e sicurezza aziendale. La manipolazione non è più episodica ma organizzata, scalabile e sempre più difficile da intercettare. È quanto emerge dal primo Deepfake Intelligence Report prodotto da IdentifAI, la startup italiana che ha sviluppato una piattaforma tecnologica innovativa basata sull’intelligenza artificiale “degenerativa”, in grado di riconoscere con un’elevata probabilità se un’immagine o un video siano stati prodotti da una IA generativa oppure da un essere umano al fine di rendere l’utilizzatore consapevole di ciò che sta osservando.

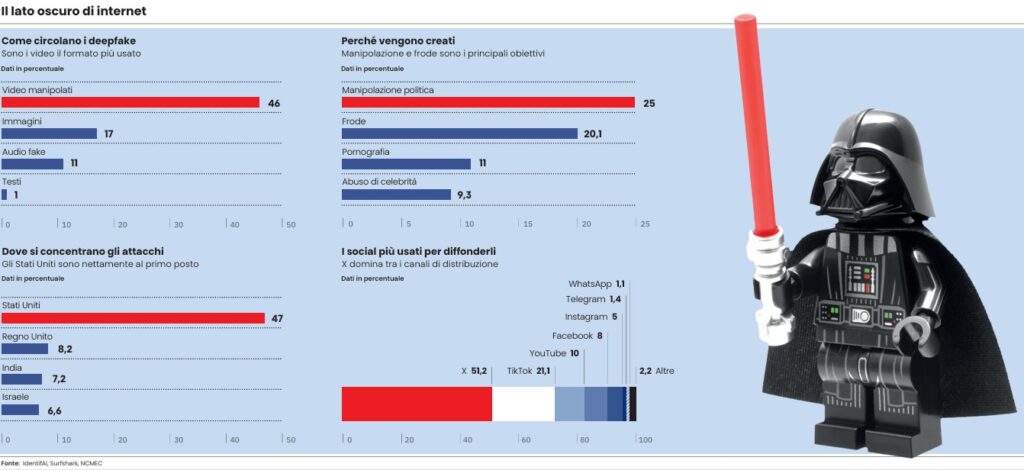

L’analisi ha coperto un arco temporale compreso tra il 2020 e i primi mesi del 2026 e ha riguardato l’ambiente digitale mondiale. Il 46% delle minacce agite a livello mondiale con l’utilizzo di deepfake avviene mediante video manipolati. Non si tratta di una coincidenza. Il video è il formato più efficace perché combina immagine, voce e contesto, rendendo l’inganno immediatamente credibile. In un ambiente informativo dominato dalla velocità, la percezione visiva continua a prevalere sulla verifica razionale.

Attenzione, però, ai moventi: quasi un video su quattro, il 24,6%, ha avuto finalità di manipolazione politica, mentre uno su cinque, il 20,1%, mirava alla frode. La pornografia ha riguardato l’11,3% delle manipolazioni, mentre l’abuso di celebrità e la satira registrano rispettivamente il 9,3% e il 3,2% di esse, a conferma di quanto questi strumenti siano indirizzati prevalentemente alla sovversione o alterazione politica e alla monetizzazione. Mentre il primo obiettivo è perseguito sostanzialmente da minacce permanenti avanzate sostenute da governi ostili o da gruppi di hacktivisti, il secondo è tipico dei gruppi cyebrcriminali, che abbattono così notevolmente il costo del social engeneering necessario a penetrare i sistemi aziendali. Anche i deepfake pornografici possono essere utilizzati a scopo estorsivo, ma possono avere anche finalità politiche attraverso attacchi reputazionali a obiettivi pubblicamente esposti.

Quel mix sapiente

Spesso i vettori di attacco non sono univoci, bensì mutivariabili, con l’utilizzo sapientemente miscelato, a seconda degli obiettivi prescelti e dei veicoli di disseminazione identificati, di diverse modalità: una campagna può ad esempio utilizzare una immagine statica sintetica per affermare una falsa narrativa su X, successivamente validata da un testo generato artificialmente e amplificato da ondate algoritmiche su TikTok.

La gran parte degli incidenti ha riguardato gli Stati Uniti, dove si è concentrato il 46,9% degli attacchi, in gran parte orchestrati con vettori multivariabili per aumentarne l’efficacia. Non è solo una questione di dimensione del mercato, ma di esposizione: maggiore è la dipendenza da processi digitali, maggiore è la superficie di attacco. Ben lontano, al secondo posto, il Regno Unito con l’8,2% degli episodi, seguito dall’India con il 7,2% e Israele con il 6,6%.

Gli attori malevoli prediligono lo sfruttamento dell’amplificazione algoritmica consentita da piattaforme di social network come X, canale di distribuzione primario dei deepfake con il 51,2% degli incidenti rilevati, o TikTok, dove ha viaggiato il 21,1% degli atti ostili perpetrati attraverso video manipolati o interamente generati con la IA, o YouTube, con il 10% dei casi.

Il report mostra una convergenza tra due mondi che fino a pochi anni fa erano separati. I deepfake non servono più solo a influenzare opinioni o destabilizzare il dibattito pubblico, ma diventano strumenti diretti di monetizzazione. Nella sfera politica, la logica è quella della velocità: il contenuto deve diffondersi rapidamente, sfruttando i meccanismi di amplificazione algoritmica prima che intervengano verifiche o smentite. Non è necessario che sia perfetto, è sufficiente sia plausibile. Nel contesto aziendale, invece, la qualità dell’inganno diventa decisiva. La clonazione vocale e i deepfake in tempo reale consentono di simulare conversazioni credibili con dirigenti e responsabili finanziari.

Se in passato il danno era principalmente reputazionale o politico, oggi diventa immediatamente economico. Le organizzazioni si trovano esposte non solo a campagne di disinformazione, ma a tentativi diretti di sottrazione di risorse finanziarie attraverso l’inganno digitale. A essere colpita, in ultima analisi, è la fiducia. I sistemi economici e istituzionali si fondano sull’assunto implicito che ciò che viene visto o ascoltato sia autentico e questo presupposto sta venendo meno.

Parallelamente si osserva uno spostamento verso bersagli ad alto valore. I dirigenti aziendali, in particolare i profili apicali, diventano il punto di ingresso privilegiato per operazioni di frode. Nei prossimi mesi è attesa una diffusione crescente di deepfake in tempo reale, capaci di intervenire direttamente nelle interazioni digitali, dalle riunioni aziendali ai processi di identificazione. Questo scenario riduce drasticamente i tempi di reazione e rende obsolete molte delle attuali contromisure, ancora basate su verifiche successive alla diffusione del contenuto. Il limite principale delle difese oggi disponibili è proprio questo: la loro natura reattiva.

Il fact-checking giornalistico, pur essenziale, interviene quando il contenuto ha già circolato. Le piattaforme digitali faticano a bilanciare velocità e controllo. Le aziende, dal canto loro, continuano a basarsi su procedure che presuppongono l’autenticità delle comunicazioni interne. Non basta più individuare il falso, occorre garantire l’autenticità del vero con sistemi di verifica più avanzati, basati su controlli biometrici multi-modali, standard di provenienza dei contenuti e integrazione della sicurezza a livello infrastrutturale.

Leggi anche:

1. “Attenzione a link e banner”. L’allarme della Polizia postale sulle nuove truffe finanziarie

2. Criptofurto con destrezza così ci frodano i finti guru

© Riproduzione riservata